Responda rápido: qual foi a última vez que você esteve em um museu? É bem possível que sua resposta seja “foi há bem pouco tempo”. E essa é uma excelente notícia!

Nos últimos anos, especialmente após a pandemia da COVID-19, as pessoas voltaram a frequentar os museus. No Brasil, segundo dados do Google Trends, as buscas cresceram 22% no ano de 2024 (o mais recente da pesquisa), e a média anual de visitação já supera os 30 milhões de pessoas. E os próprios museus estão na “boca do povo”: MASP, MON, Museu do Amanhã, Museu da Língua Portuguesa, Museu Histórico Nacional, Museu Catavento, Museu Imperial…

Além disso, dados globais mostram que, a cada ano, os cem maiores museus do mundo recebem cerca de 175 milhões de visitantes – e este número está crescendo.

Mas, por que o interesse das pessoas pelos museus aumentou?

Porque essas instituições se modernizaram, trazendo temas instigantes e oferecendo experiências que vão muito além da imagem “clássica” de peças na vitrine ou de depósitos de patrimônio.

Os museus, enfim, estão mais vivos do que nunca. Valorizando, preservando, compartilhando e construindo História, Ciência, Arte e Conhecimento. Mas há, é claro, desafios que também devem ser conhecidos.

Nesta edição da série #EducaçãoHumaniza – em homenagem ao Dia Internacional dos Museus, que será celebrado no próximo dia 18 de maio – vamos falar sobre a origem, a evolução e os desafios dos museus.

A visita já vai começar – venha com a gente!

A coleção do rei

Para muita gente, a primeira ideia que vem à mente quando se fala em “museu” é a de uma coleção de objetos que contam coisas: pinturas, estátuas, múmias, fósseis, moedas, animais empalhados, armaduras, peças religiosas, máquinas e mais. Essa imagem faz todo sentido.

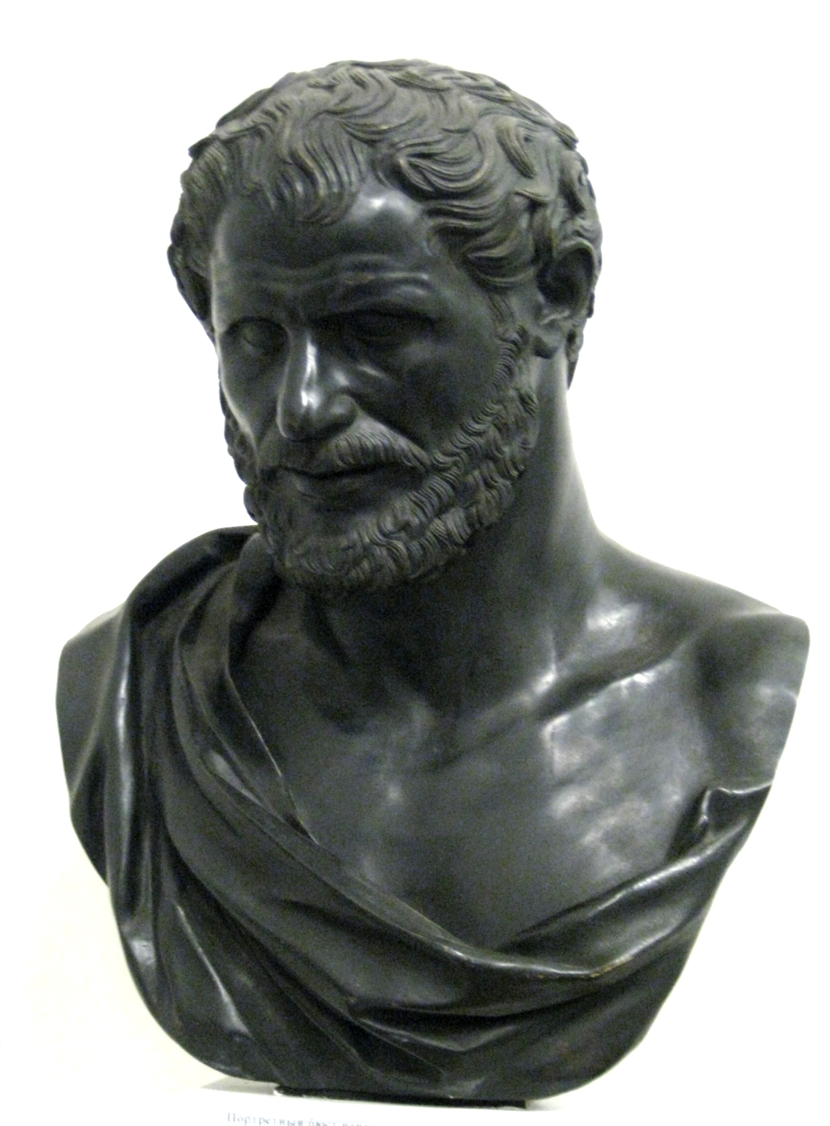

Porque os museus surgiram, de fato, como “coleções para mostrar e contar”. E nasceram há muito tempo, na Antiguidade, em culturas como a mesopotâmica, a egípcia, a grega e a romana.

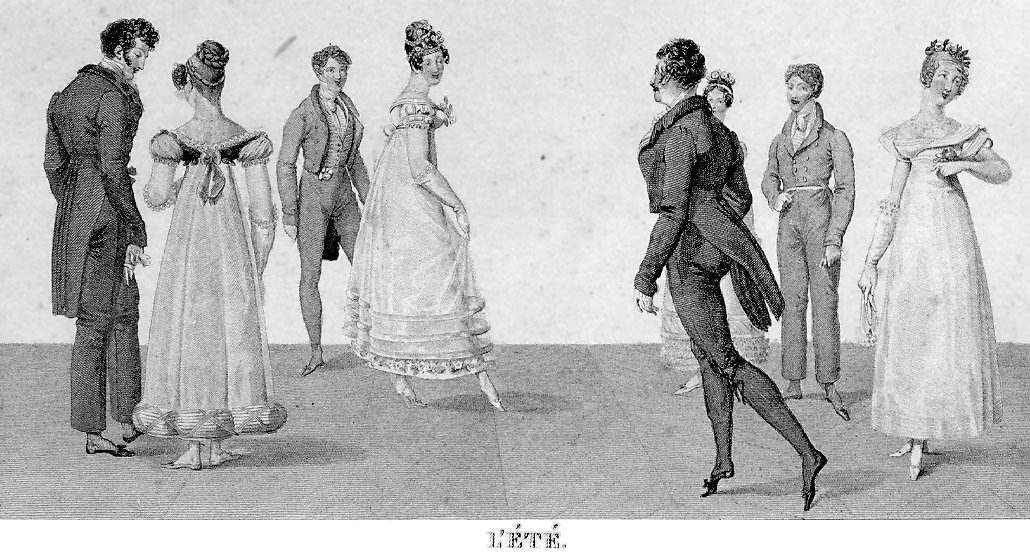

Os poderosos de então – comandantes militares, reis, imperadores – reuniam grandes botins e queriam compartilhá-los com seus semelhantes, mostrando suas conquistas, o alcance de suas jornadas e até o “estranho e maravilhoso” que ficava para além das fronteiras do próprio reino. Queriam “apresentar o mundo”, demonstrando riqueza e, principalmente, poder.

Essa forma de “ser museu”, aliás, perdurou por muito tempo. No período colonial, impérios como o Espanhol, Francês, Russo ou Britânico faziam exatamente o mesmo. Montavam grandes coleções de peças retiradas de seus domínios e de regiões invadidas, expondo-as, agora, para os pares e, agora, para o povo.

Visitando o “Gabinete de Curiosidades”

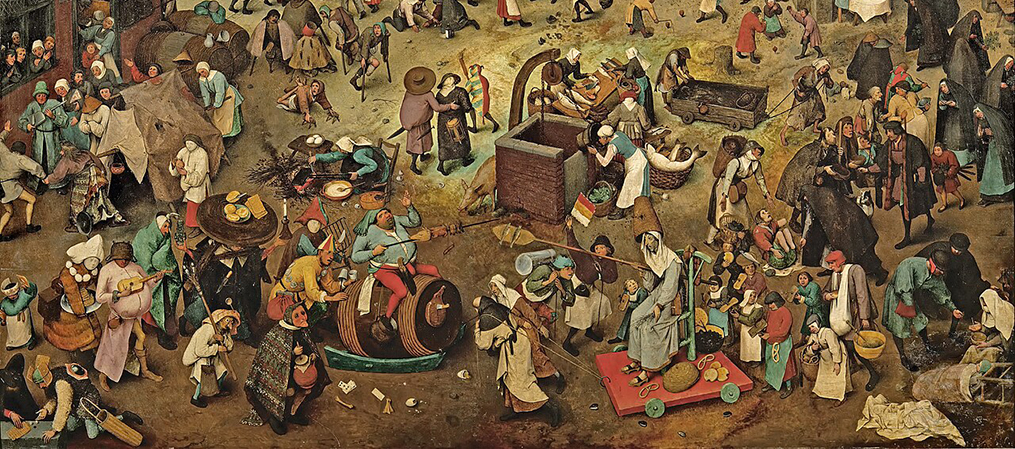

Ao ler os parágrafos acima, você provavelmente ficou com a impressão de que os museus, no início, tinham como grande finalidade mostrar uma visão de mundo ligada a poder e, também, a uma ideia de “nós e eles”, de povos mais civilizados e de povos “exóticos”. E é isso mesmo!

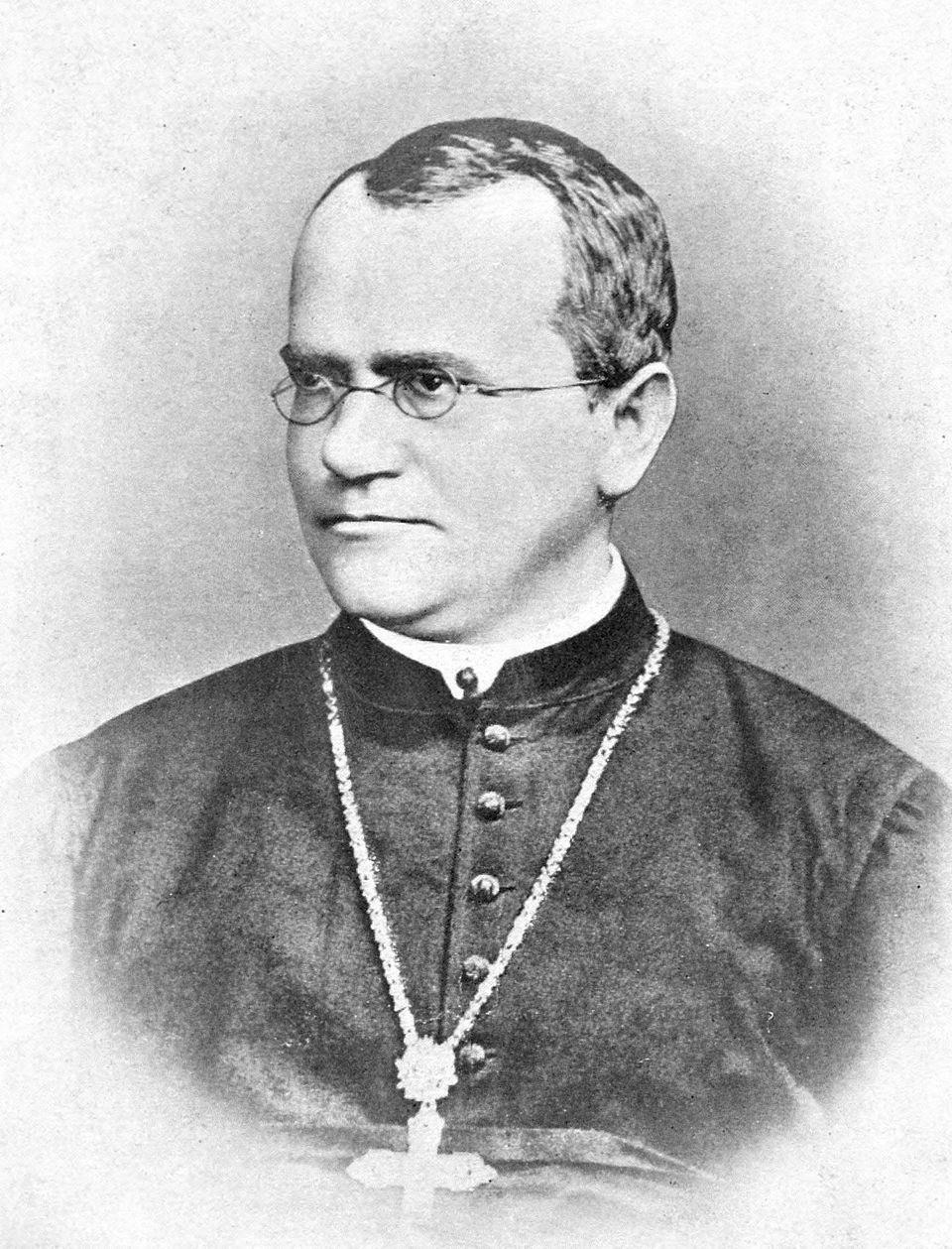

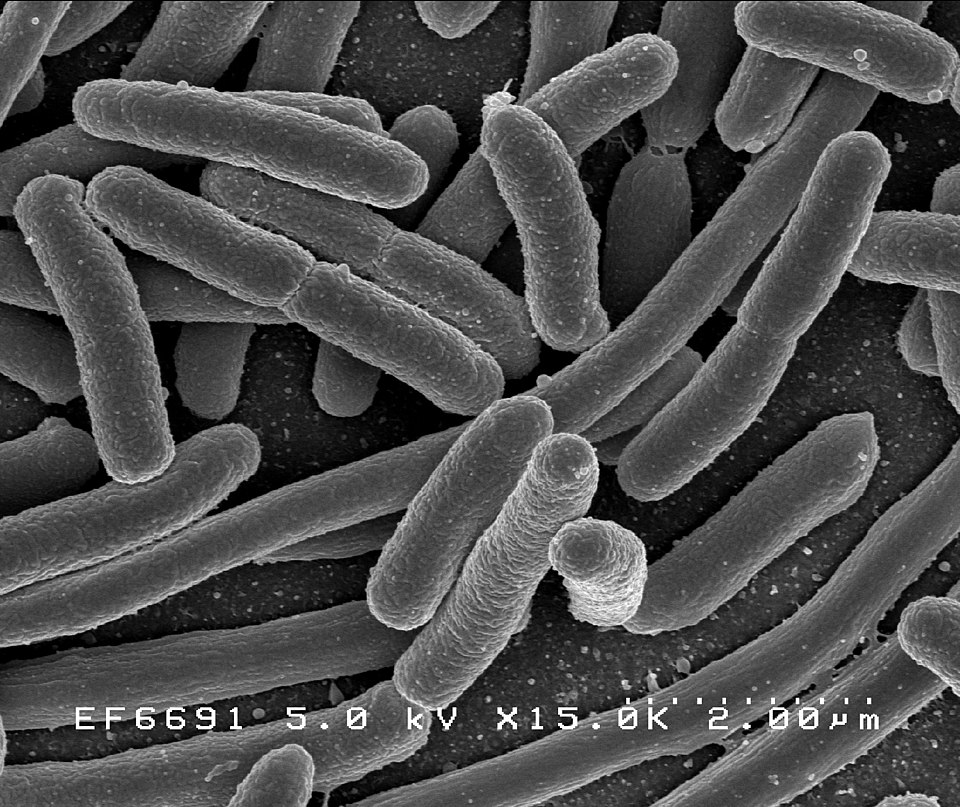

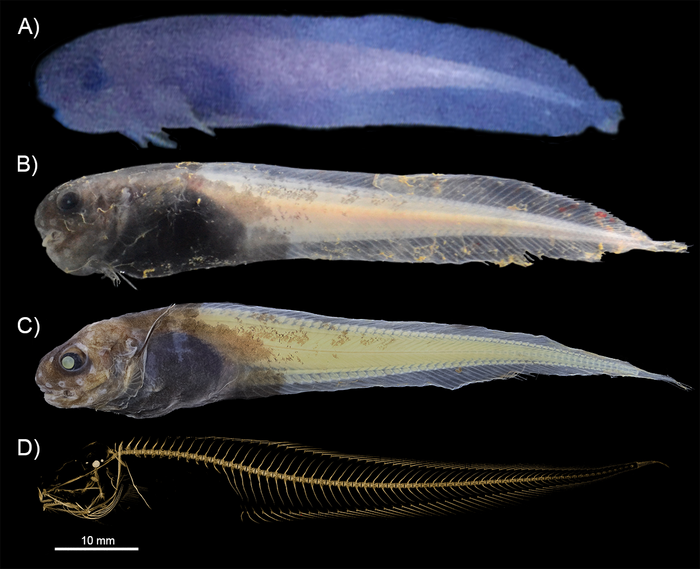

O colecionar, então, era visto como um traço de superioridade sobre aquelas culturas que não colecionavam. Some-se a isso, em tempos mais modernos, a Revolução Científica (do século XVI, com grande expansão nos séculos XVIII e XIX), que gerou um enorme movimento de descoberta, catalogação e publicidade dos achados – animais, insetos, plantas, fósseis, antigos textos, peças arqueológicas etc. Vivia-se, então, entre a realidade do “Gabinete de Curiosidades” e a das primeiras tentativas de catalogar, organizar e mostrar descobertas científicas.

Os primeiros museus modernos

O primeiro museu moderno, aquele que inaugura o que conhecemos como tal, foi o Ashmolean Museum, fundado em 1683 na cidade inglesa de Oxford. Elias Ashmole herdou e assumiu os direitos sobre uma enorme coleção dos naturalistas John Tradescant (pai e filho) e a doou à Universidade de Oxford.

A instituição construiu um edifício para abrigar esse acervo, dando origem ao Ashmolean. Atualmente, o museu segue sendo um dos principais do mundo, com um acervo de mais de um milhão de peças, abrangendo do Antigo Egito ao Japão, passando por obras de Michelangelo, moedas, máscaras funerárias e muito mais.

Outro museu (na verdade, um conjunto de museus) pioneiro e extremamente importante é o do Vaticano, que a partir de meados do século XVIII começou a organizar seu acervo em galerias e abrir estes espaços à visitação. O acervo dos Museus Vaticanos é um verdadeiro tesouro – são 70 mil peças de arte e arqueologia distribuídas em nada menos do que 1.400 salas na própria cidade-Estado do Vaticano!

O terceiro dos museus “fundantes” da Era Moderna é o do Louvre, que passou de coleção real de arte a museu nacional francês em 1793, na esteira da Revolução Francesa. Com 38 mil peças – e um acervo que cresceu muito ao longo da Era Napoleônica e de todo o século XIX –, o Louvre é, atualmente, o maior museu de arte do mundo! Em tempo: é, também, o mais visitado, com cerca de 10 milhões de visitantes por ano (uma média de 27 mil visitantes por dia!).

Outros museus que não podem ficar de fora desta lista de “pioneiros incríveis” são o Hermitage, inaugurado em 1764 na cidade russa de São Petersburgo, o Museu Britânico (fundado em 1753), de Londres, e o Metropolitan Museum of Art, de Nova Iorque (1870). Há, é claro, muitos outros museus magníficos (que vamos listar no final deste artigo), mas os citados são os pioneiros.

O “pulo do gato” dos museus

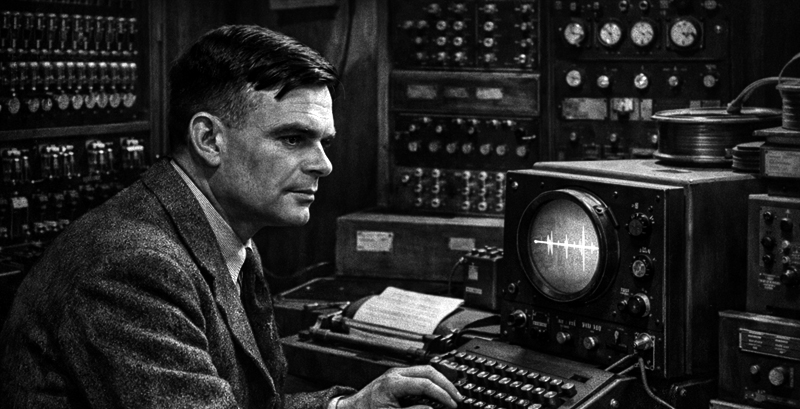

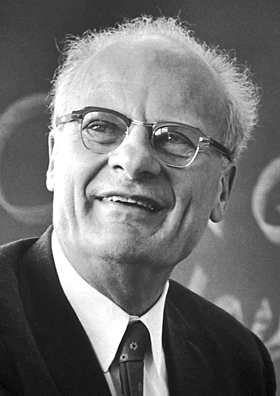

O século XX e as primeiras décadas do século XXI trouxeram grandes novidades. Estamos falando do cinema, da tevê, do rádio, da computação e de avanços extraordinários nas técnicas da indústria gráfica. Todas essas novidades, todas essas tecnologias, refluíram para os museus a partir do momento em que eles mudaram de paradigma.

E que mudança foi essa? Eles deixaram apenas de “mostrar acervos” de forma acrítica e passaram a envolver os visitantes em experiências mais profundas, comunicacionais e sensoriais. O museu, enfim, deixou de ser o “Gabinete de Curiosidades” e passou a oferecer uma experiência viva, que comunica o acervo e vai além.

Essa mudança se conecta a uma transformação na museologia, que, especialmente a partir dos anos 1960 e 1970, caminhou para oferecer algo diferente e encantador. Mudanças na arquitetura dos prédios, exposições que caminham para fora do espaço museológico, temas e acervos voltados a públicos específicos como as crianças, oferta de experiências científicas (no caso dos museus de ciência e tecnologia) e interações digitais “romperam a vitrine” do passado e colocaram os acervos mais perto das pessoas. Essas mudanças, que efetivamente promoveram um retorno das pessoas aos museus, também foram importantes para o financiamento das próprias instituições – todas elas têm gastos importantes com a conservação, a pesquisa e a expansão dos acervos.

Museus que se mexem!

Muito bem: você quer exemplos de museus modernos e altamente interativos? Vamos a eles! O paulistano Museu da Língua Portuguesa, com suas muitas experiências interativas dentro do nosso idioma, é um deles. O Museu de História Natural de Nova York (AMNH), com seu teatro imersivo 360° e aplicativos de realidade aumentada que “dão vida” a dinossauros extintos, é outro. No campo da tecnologia, merecem destaque o Deutsches Museum, de Munique (Alemanha) – o mais antigo museu do gênero no mundo, fundado em 1903 –, e o Seoul Robot & AI Museum (RAIM), inaugurado em 2024 – o primeiro museu do mundo dedicado à robótica e à IA.

Nosso Museu Nacional, atualmente em fase final de reconstrução – fundado em 1818, ele foi destruído por um incêndio devastador em 2018 –, também promete estar entre os mais importantes e interativos do mundo. E por quê? Porque, entre seus desafios, estão atrair público e, especialmente, recuperar e recontar a história das peças destruídas – algo que só será possível pela soma entre pesquisa de alta qualidade e entrega digital precisa.

E os desafios?

Mas, como fazer isso? A resposta a esta pergunta pode representar um novo salto para os museus. Há, porém, desafios importantes. O primeiro: levar essa transformação para um número muito maior de instituições. Para além dos grandes museus, afinal, há dezenas de milhares de outros que, muitas vezes, ainda reproduzem o modelo “Gabinete de Curiosidades”. Apenas para se ter uma ideia: no Brasil há 4.024 museus cadastrados no Instituto Brasileiro de Museus (Ibram) – muitos, em especial os das cidades menores, ainda não “deram o salto” de qualidade.

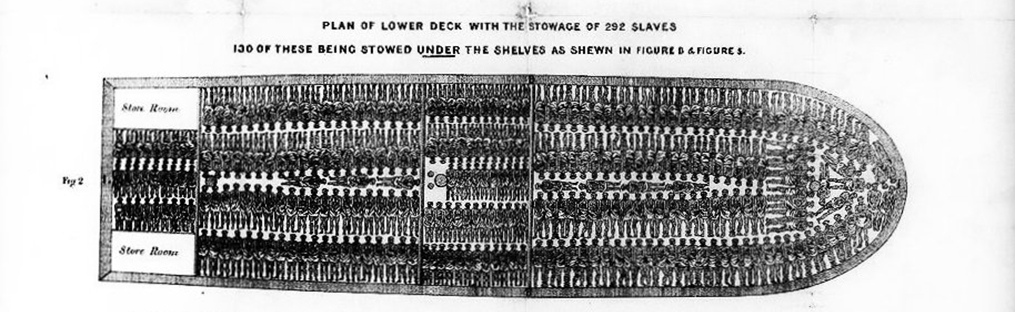

Outro desafio, monumental, diz respeito ao repensar dos governos e das gestões dos museus em relação aos seus acervos. Na medida em que muitas coleções foram construídas no período colonial – em muitos casos, a partir de saques, confiscos e compras ilegais –, há uma questão séria que envolve a titularidade dos acervos e a necessidade de repatriação de peças.

Apenas para ficar em alguns exemplos, entre os acervos “problemáticos” estão coleções associadas às religiões e religiosidades de povos originários (como objetos rituais e até restos humanos de grupos indígenas americanos), peças saqueadas em guerras e relíquias arqueológicas como os bronzes do Benin, África (hoje, em vários museus), os frisos do Parthenon, em Atenas (atualmente no Museu Britânico), o busto da rainha egípcia Nefertiti (atualmente no Neues Museum, em Berlim) e a Pedra de Rosetta (peça-chave na decifração dos hieróglifos egípcios, hoje no Museu Britânico).

Mas, não seria simples apenas repatriá-los, devolvendo-os às sociedades de origem? Sim e não. Se, por um lado, já há movimentos importantes nesse sentido – como a entrega, ao Brasil, de mantos tupinambás em penas de guará (do século XVII) que estavam no Museu Nacional da Dinamarca –, por outro há questões econômicas envolvidas. Peças como o busto de Nefertiti, por exemplo, são “estrelas” que atraem milhares de pessoas do museu. Sem contar o risco, que não deve ser desprezado, de as peças retornarem a lugares sem capacidade de conservar e mostrar os acervos. Algo que, em tese, poderia ser resolvido por uma expansão dos museus e da cultura museológica, o que demanda investimentos e interesse político.

Conclusão

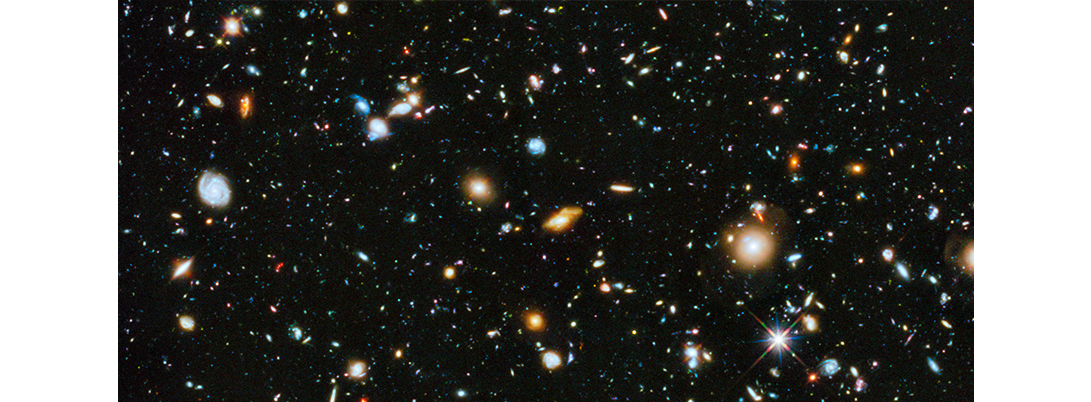

Neste artigo, pudemos perceber como os museus evoluíram. E evoluíram, em essência, porque refletem a evolução das sociedades e da tecnologia. Esse processo, porém, também marca conflitos que cresceram nas últimas décadas. O maior deles, o do respeito às culturas do mundo e à necessidade de promoção da interculturalidade nas relações entre os povos. Outro desafio é o da democratização desse novo modelo, que deve alcançar os milhares de museus do mundo e não apenas as grandes instituições.

Se conseguirmos dar esse salto, os museus – esses espaços vivos de memória e descoberta – terão, de fato, encontrado o caminho para o futuro. Um passo importante nesse sentido é o interesse das pessoas pelos seus museus. Assim, deixamos o convite: vá aos museus! Prestigie o museu da sua cidade!

Museus para conhecer:

O mundo possui milhares de museus, e muitos deles são simplesmente sensacionais. Abaixo, listamos apenas alguns deles que podem ser conhecidos pela internet:

Hermitage Museum, São Petersburgo

Instituto Inhotim, Brumadinho, Minas Gerais

Metropolitan Museum of Art (MET), Nova Iorque

Museo Nacional del Prado, Madrid

Museu de Arte de São Paulo (MASP), São Paulo

Museu Britânico, Londres

Museu da Acrópole, Atenas

Museu de História Natural (AMNH), Nova Iorque

Museu do Louvre, Paris

Museu Imperial, Petrópolis, Rio de Janeiro

Museu Nacional, Rio de Janeiro

Museu Oscar Niemeyer (MON), Curitiba

Museus do Vaticano, Roma

National Palace Museum, Taipei, Taiwan

New York Hall of Science (NYSCI), Nova Iorque

Novo Museu Egípcio, Cairo

Smithsonian National Air and Space Museum, Washington

Tate Modern, Londres